Терминальный доступ к рабочим столам: почему отказывает один сервер и как это исправить

Когда компания переходит на удалённую работу или разворачивает виртуальные рабочие столы, перед ИТ‑отделом встаёт непростая задача: как обеспечить сотрудникам быстрый и бесперебойный доступ к их привычному рабочему окружению. Обычное решение - использовать терминальный доступ к рабочим столам через протокол RDP или аналоги.

Однако при масштабировании такой подход быстро упирается в ограничения одного сервера. Здесь на помощь приходят механизмы балансировки нагрузки и обеспечения высокой доступности, которые позволяют распределять подключения между несколькими узлами и автоматически переключать трафик в случае сбоя.

Контекст: почему балансировка критична для терминального доступа

До недавнего времени типичная архитектура терминального доступа выглядела так: один сервер с ролью узла удалённых рабочих столов (RDSH), к которому подключались пользователи.

Такой подход прост, но имеет очевидные недостатки: при высокой нагрузке сервер начинает тормозить, а при аппаратном сбое работа останавливается полностью. С ростом числа сотрудников и переходом на гибридные форматы работы потребовались более гибкие схемы.

Фермы терминальных серверов позволили объединить несколько узлов в единый пул ресурсов. Но просто собрать серверы недостаточно - нужен «диспетчер», который решит, какой именно узел получит новое подключение. Эту роль выполняет балансировщик нагрузки.

Он следит за состоянием каждого сервера, собирает статистику по загрузке и направляет входящие RDP-сессии на наименее загруженный или наиболее подходящий узел.

Более того, современные балансировщики способны анализировать содержимое запроса (например, имя пользователя или название приложения) и направлять трафик на конкретную группу серверов, выделенную под определённые задачи.

Основные механизмы балансировки нагрузки

В основе любой системы распределения нагрузки лежат алгоритмы, определяющие, какой сервер получит очередной запрос. Простейший из них - round‑robin, когда подключения поочерёдно передаются всем узлам.

Он не учитывает реальную загрузку, поэтому на практике чаще используют наименьшее число активных соединений (least connections) или взвешенное распределение (weighted round‑robin), где более мощным серверам можно задать больший вес.

Для терминального доступа особую важность приобретает привязка к источнику (source affinity). Если пользователь во время работы потеряет соединение, желательно, чтобы его новая сессия попала на тот же самый сервер, где хранится состояние предыдущей сессии. Хотя протокол RDP поддерживает повторное подключение к существующей сессии, при смене узла это может работать некорректно.

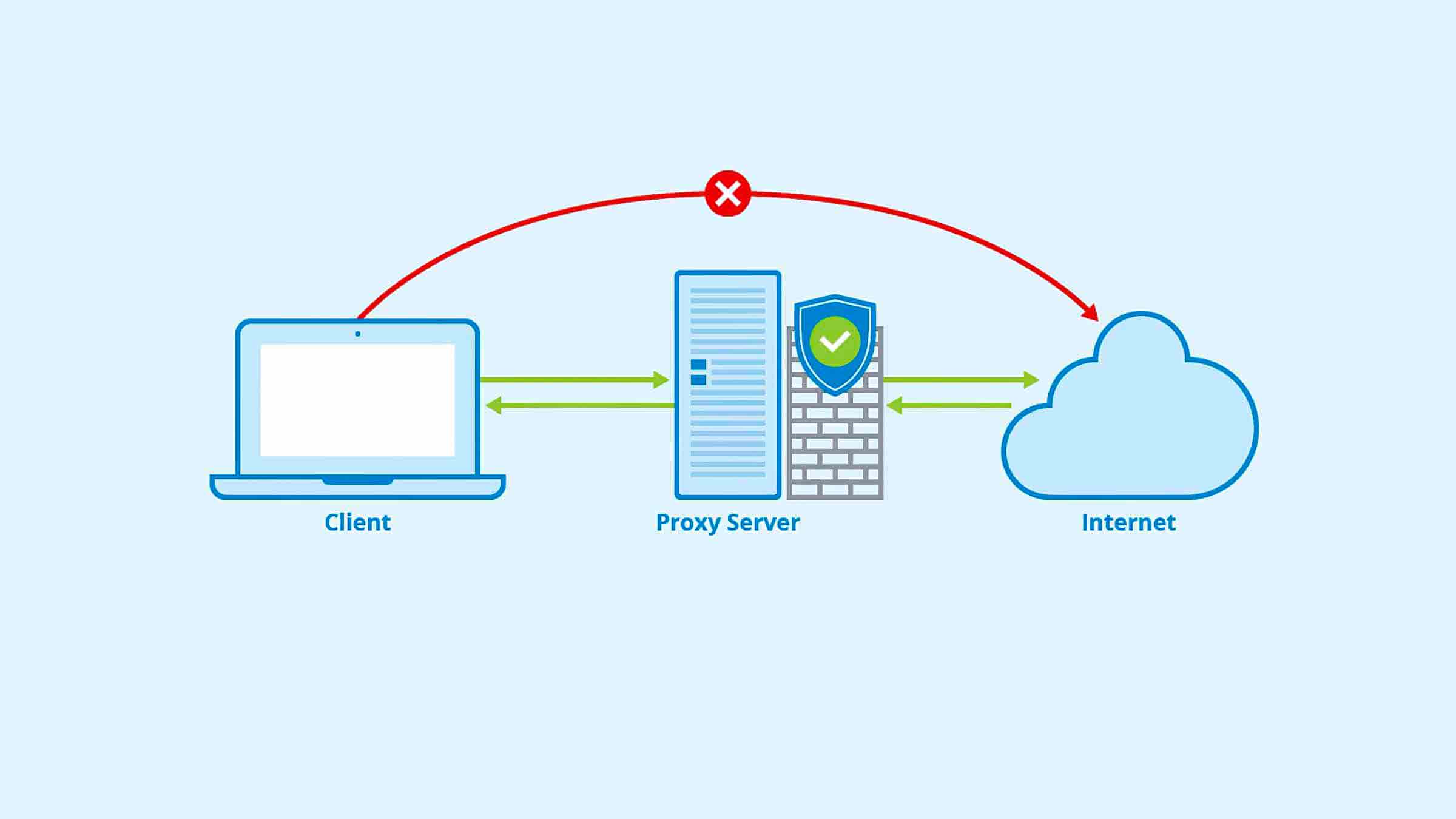

Ключевым техническим элементом выступает обратный TCP‑прокси. Он принимает входящие RDP-соединения на один публичный адрес, устанавливает фоновое соединение с выбранным бэкенд-сервером и прозрачно проксирует трафик.

Такая архитектура позволяет скрыть внутреннюю структуру фермы и добавляет точку управления, где можно применять политики безопасности, логирование и модификацию содержимого запросов.

Модификация содержимого запросов - ещё одна мощная возможность. Например, балансировщик может подменять заголовки или добавлять служебную информацию, которая помогает целевому серверу идентифицировать пользователя или применять нужные настройки рабочего стола.

Обеспечение высокой доступности

Балансировка нагрузки и высокая доступность (HA) - две стороны одной медали. Балансировщик сам по себе становится единой точкой отказа, поэтому его также необходимо кластеризовать. В типовой схеме два или более экземпляров балансировщика работают в режиме активный‑активный или активный‑пассивный, используя виртуальный IP‑адрес (VRRP).

Для обеспечения HA на уровне бэкенд‑серверов балансировщик должен постоянно проверять их состояние (health checks). Для RDP-сервисов это может быть проверка доступности порта 3389, а для более точной диагностики - тестовое подключение с последующим разрывом. Если сервер перестаёт отвечать, балансировщик временно исключает его из пула до восстановления работоспособности.

При развёртывании в нескольких географических площадках (ЦОД) добавляется ещё один уровень: балансировщик может направлять трафик в ближайший или наименее загруженный дата-центр. Это требует синхронизации сессий между ЦОД (например, через репликацию баз данных брокера подключений) и использования глобальной балансировки DNS или Anycast.

Практические сценарии и примеры

Рассмотрим два типичных кейса.

Кейс 1: Распределение RDP-подключений между двумя ЦОД.

У компании есть основная и резервная площадки. На каждой развёрнута ферма терминальных серверов. Балансировщик, настроенный на гео‑маршрутизацию, направляет пользователей из Москвы в московский ЦОД, а из Владивостока - в дальневосточный.

Если основной ЦОД недоступен, балансировщик автоматически перенаправляет весь трафик на резервный. При этом важно, чтобы профили пользователей и сессии синхронизировались между площадками (например, с помощью roaming profiles или FSLogix).

Кейс 2: Балансировка доступа к виртуальным рабочим столам (VDI) с разными пулами приложений.

В организации есть пул «Тяжёлые приложения» (CAD, 3D‑моделирование) и пул «Офисные приложения». Пользователь обращается к единому шлюзу, но в зависимости от его группы в Active Directory или указанного в запросе имени приложения балансировщик направляет сессию на соответствующий пул.

Это позволяет эффективно использовать ресурсы и избегать конфликтов производительности.

Сравнительный анализ: встроенные средства Windows vs специализированные балансировщики

Microsoft предлагает собственные инструменты для балансировки RDS: сетевую балансировку нагрузки (NLB) и шлюз удалённых рабочих столов (RD Gateway) с поддержкой ферм. NLB работает на уровне IP‑адресов и не анализирует содержимое запросов. RD Gateway может использовать политики для распределения, но его функционал ограничен.

Специализированные балансировщики (такие, как упомянутый продукт) дают больше гибкости:

- Анализ содержимого: маршрутизация на основе имени приложения, пользователя, типа клиента.

- Модификация запросов: подстановка HTTP‑заголовков для веб‑доступа к RDP, изменение TTL и т.д.

- Единый интерфейс управления: графический или CLI, который объединяет мониторинг нескольких кластеров и площадок.

- Расширенные алгоритмы: возможность задавать сложные комбинации условий для выбора бэкенда.

Платой за гибкость становится дополнительный компонент в инфраструктуре, который нужно поддерживать. Однако для сред, где важна отказоустойчивость и точное распределение нагрузки, такой выбор оправдан.

Прогнозы и перспективы

С развитием облачных технологий и гибридных сред балансировка терминального доступа будет всё теснее интегрироваться с контейнерными платформами и оркестраторами. Уже сейчас появляются решения, которые позволяют динамически масштабировать пулы терминальных серверов в зависимости от нагрузки, используя метрики балансировщика как триггер для автоскейлинга.

В перспективе 3–5 лет ожидается активное внедрение алгоритмов машинного обучения для предсказания пиковых нагрузок и упреждающего перераспределения ресурсов. Это снизит влияние человеческого фактора и повысит общую надёжность.

Выводы и рекомендации

Обеспечение надёжного терминального доступа - это не просто установка нескольких RDP‑серверов, а грамотное проектирование системы балансировки и высокой доступности. Ключевые моменты:

- Используйте балансировку нагрузки, чтобы распределить трафик и избежать перегрузки отдельных узлов.

- Внедряйте мониторинг состояния серверов и автоматическое исключение отказавших.

- Для крупных или географически распределённых инфраструктур рассмотрите специализированные балансировщики, дающие больше контроля над трафиком.

- Не забывайте о высокой доступности самого балансировщика - кластеризуйте его.

При выборе конкретного инструмента отталкивайтесь от масштаба, бюджета и потребности в тонкой настройке маршрутизации.

Расширенный FAQ

Вопрос: Что делать, если при отказе одного сервера пользователь теряет сессию и не может к ней вернуться?

Ответ: Убедитесь, что у вас настроена репликация сессий или используются профили с поддержкой перемещения между серверами (например, FSLogix). Балансировщик должен поддерживать привязку к источнику, чтобы повторное подключение направлялось на тот же узел.

Вопрос: Как проверить, что балансировка работает правильно?

Ответ: Используйте тестовые подключения с разных IP‑адресов и наблюдайте, на какие серверы они попадают. Современные балансировщики предоставляют дашборды с метриками распределения нагрузки и статусами бэкендов.

Вопрос: Нужно ли использовать отдельный шлюз (RD Gateway) вместе с балансировщиком?

Ответ: Да, если вы хотите публиковать терминальный доступ через интернет без прямого доступа к RDP-портам. Балансировщик может располагаться перед шлюзом, распределяя входящие HTTPS‑соединения между несколькими экземплярами шлюза.

Вопрос: Какие алгоритмы лучше для терминального доступа?

Ответ: Рекомендуется комбинация: привязка к источнику (source affinity) плюс наименьшее число соединений. Это сохраняет сессии на одном узле, но при старте новой сессии выбирается наименее загруженный сервер.